지난 6월 대만 고속도로를 자율주행하던 테슬라 군의 모델 3 차량이 전복된 대형 트럭을 들이받는 사고가 발생했습니다 최첨단 기술을 자랑한 테슬라의 사고를 보면서 자율주행의 안전성 평가에 대한 논의가 대두되고 있습니다. 자율주행 과정과 그 중에서도 인지 평가를 어떻게 할 것인지 부분을 살펴보겠습니다.

자율주행 프로세스, 자율주행은 인지·판단·제어의 3단계 프로세스로 이루어집니다. 우선 인지는 인간의 눈이나 귀 등의 감각 기관에 해당합니다. 다양한센서로부터입력된데이터신호값을처리하여주행환경이나장애물등주위의모든물체의존재를인식하는것을말합니다. 인식값을 바탕으로 장애물의 종류와 거리, 속도, 방향 등을 파악합니다.판단은 인간의 뇌에 해당합니다. 눈과 귀에서 입력된 정보로 판단합니다. 주행 경로상에 장애물이 인지되면 현재 유지하고 있는 주행 상태를 유지 변경할지를 결정하고, 안전한 주행을 위해 브레이크, 조향 장치 등을 적절히 제어하기 위한 데이터 값을 결정합니다.

제어는 인간의 팔, 다리에 해당합니다. 인지-판단에 따라 정해진 데이터 값에 따라 실제 자율주행차량의 주행상태를 변경합니다. 조향(가로방향) 제어, 가/감속(세로방향) 제어를 합니다.자율주행차는 인지-판단-제어를 쉬지 않고 반복합니다. 이3단계과정중에서가장기본적이고가장중요한지에대해살펴보도록하겠습니다.

[그림 1] 자율주행 프로세스 개요

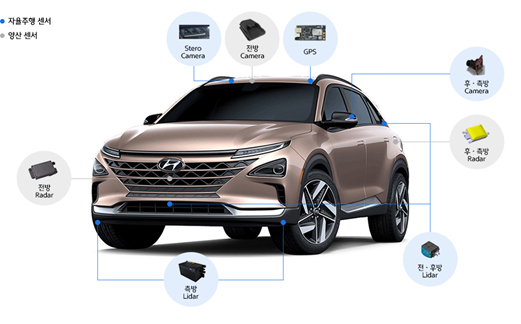

자율 주행 차량 주위의 상황인 자율 주행 차량이 주행 중에 주변 상황을 아는 것은 자율 주행의 시작 지점입니다. 주행하고 있는 도로의 차선, 보행자, 선행 차량, 고정 장애물 등을 인식해야 어떤 경로로 주행하는지 판단하는 단계로 나아갈 수 있습니다. 자율주행차는 주변 환경을 파악하고 정확한 정보를 얻기 위해서는 차량에 장착된 카메라, 레이더(Radar), 라이더(Lidar) 등의 센서 기능을 활용합니다.

[그림 2] 차량 센서의 예를 들어 첫 번째로 카메라는 인간의 눈과 가장 비슷합니다. 차선, 보행자등을 광학계를 통해서 영상으로서 취득해, 이것을 후처리 과정을 거쳐 유용 정보로서 추출합니다. 그러나 빛이 없으면 식별이 어렵듯이 빛 조건의 영향을 많이 받는 한계가 있습니다.

레이더(Radar – Radio Detection and Ranging)는 객체의 거리와 속도, 각도 등을 측정하기 위해 전자기파를 사용하는 감지 센서입니다. 카메라에 비해 눈, 비 등의 악천후에도 강하다는 장점이 있습니다.

라이더(Lidar – Light Detection and Ranging)는 레이더와 비슷하나 빛을 이용하여 주변을 탐색합니다. 빛을 쏘아 돌아오는 정보를 기본으로 이미지를 그리고, 거리나 사물의 윤곽을 탐지하는 기기로 정밀도가 높아 「자율 주행의 눈」이라고도 불리는 센서입니다. 다만 날씨에 다소 약하고 무엇보다 단가가 높아 연구목적 이외의 일반 판매용 자동차에는 장착이 어려운 상황입니다.

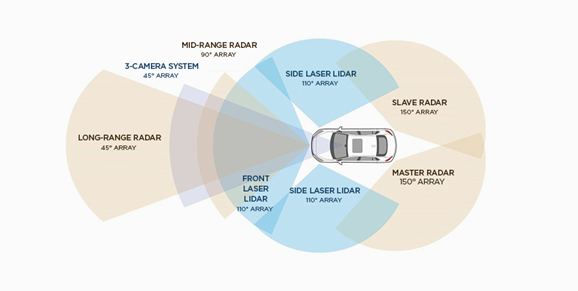

그 외 , 초음파 센서, GPS등의 센서등을 활용해, 자동 주행의 인지를 실시합니다. 이들 센서의 개별 정보를 통합하여 차량 주변 환경에 대해 정확하고 신뢰할 수 있는 지도를 생성하는 개념이 센서 퓨전 (Sensor Fusion)입니다. 센서별 장점과 단점을 고려하여 다양한 날씨 조건과 빛 조건에서 주변 상황을 정확하게 인지할 수 있도록 센서로부터 취득하는 데이터를 적절하게 조합하는 과정입니다. 센서 서로를 보완하는 기술은 물론, 충분한 중복을 통해 중복을 증가시켜 안전을 개선하는 것도 중요합니다.

[그림3] 차량용 센서별 범위

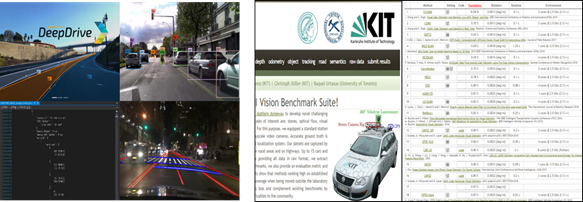

인지 소프트웨어(이하 인지 SW)란 무엇인가?인지 SW란 자율주행 상황에서 차량 주변의 대상 객체를 인지하는 SW 알고리즘입니다. 센서 퓨전 과정에서 센서로부터 취득하는 데이터를 적절히 조합하여 주변 상황에 대한 정확한 데이터를 산출하는 SW입니다. 이러한 인지 SW를 검증하고 성능을 평가하는 연구가 활발히 이루어지고 있습니다. 인지 SW의 성능을 테스트하기 위한 영상 데이터와 오픈 소스를 제공하는 기관이 있는데, 대표적인 것은 BDD(Berkley Deep Drive)와 KITTI입니다.

[ 그림 4 ] BDD ( Berkley Deep Drive ) 와 KITTI

BDD는 10만개 이상의 영상 데이터를 제공합니다. KITTI는 데이터량이 비교적 적은 인지 SW의 KITTI 데이터 셋 적용 결과를 제공합니다. 이 밖에도 바이두의 Apoloscape에도 dataset들이 다양하게 있는데요.인지 SW의 평가는 기존의 컴퓨터 비전 분야에서의 이미지 인식에 관한 평가 기법이 일반적으로 이용되고 있습니다. 평가용 영상으로부터 취득한 인지 결과의 GT(Ground Truth)값과 시험 대상인 인지 SW가 검출한 결과(Predict)간의 비교를 통해 객체 검출의 정확도를 측정하는 방법으로 mAP(Mean Average Precision)값을 지표로 합니다. 일반적인 Object Detection에서 사용되는 측정지표로서 현재 대부분의 인지SW가 이 지표를 보다 높이는 데 집중하고 있습니다.

하지만 mAP 등은 기본적으로 화면상의 객체 검출에만 초점을 맞춘 지표입니다. 자율주행 상황에서는 더욱 고려해야 할 사항이 있으며 이를 위해 추가로 평가지표를 개발하고 인지 SW의 명확하고 합리적인 검증을 수행해야 합니다. 기존 기능안전표준에서는 자율주행차에 대한 안전검증이 충분하지 않아 국제표준화기구(ISO)가 자율주행 관련 표준을 꾸준히 발행하고 있으며, Euro NCAP과 같은 성능평가 프로그램도 ADAS를 넘어 자율주행 관련 시험절차 등을 추가할 것으로 사료됩니다.

이러한 기술 트렌드에 맞추기 위해 슈아소프트텍에서도 이 부분에 대한 연구를 꾸준히 수행하고 있습니다. 도래하는 자율주행 시대를 대비하여 자율주행 관련 SW를 검증할 수 있는 도구를 개발하여 솔루션을 제공하고 있습니다.

[출처] 그림 1 – https://www.hyundai.co.kr/TechInnovation/Autonomous/ 그림 2 – www.cvlibs.net/datasets/kitti/ 그림 3 – https://bdd-data.berkeley.edu/http://www.cvlibs.net/datasets/kitti/://www.cvlibs.net/datasets/kitti/